服務(wù)熱線

0755-83044319

發(fā)布時間:2025-04-04作者來源:薩科微瀏覽:921

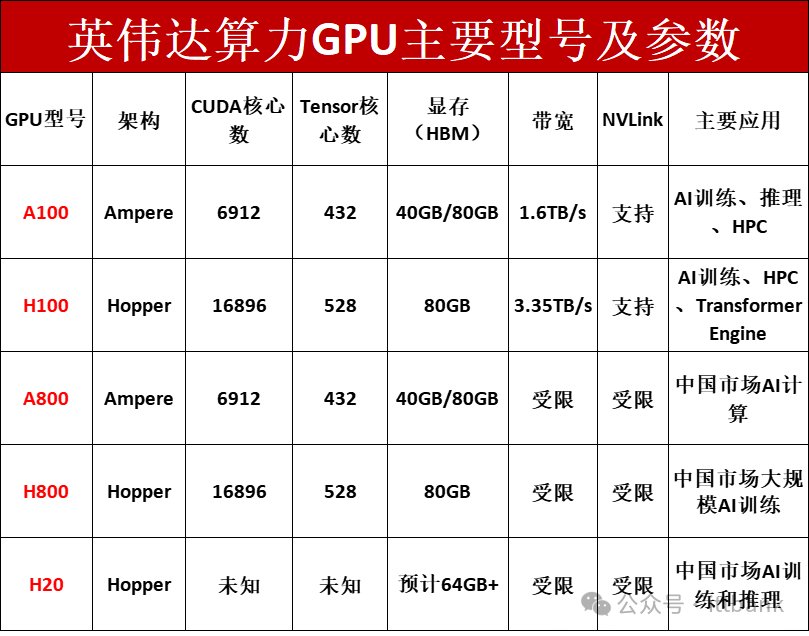

A100是英偉達(dá)2020年發(fā)布的旗艦級數(shù)據(jù)中心GPU,基于Ampere架構(gòu),主要特性包括:

A100可廣泛應(yīng)用于高性能計算(HPC)和深度學(xué)習(xí)任務(wù),適用于需要大量計算資源的企業(yè)級用戶。

H100是A100的升級版,采用更先進(jìn)的Hopper架構(gòu),相比A100提升了數(shù)倍的計算性能,主要特性包括:

H100特別適用于大型AI模型訓(xùn)練,比如Llama、GPT、Stable Diffusion等,可以大幅提升訓(xùn)練效率。

A800和H800是英偉達(dá)專為中國市場推出的受限版GPU,以符合美國的出口管制要求:

這些GPU主要面向中國客戶,如阿里云、騰訊云、百度云等云計算廠商,性能稍遜于A100和H100,但仍然具備極高的計算能力。

H20是英偉達(dá)為中國市場設(shè)計的新一代受限版H100,預(yù)計將取代H800:

H20仍然具備強大的算力,適用于AI訓(xùn)練和推理,但具體性能指標(biāo)需等待正式發(fā)布后確認(rèn)。

如果你想搭建自己的算力中心,無論是用于AI訓(xùn)練,還是進(jìn)行高性能計算,都需要從以下幾個方面考慮:

首先需要明確你的算力需求:

你可以選擇以下方式搭建你的GPU算力中心:

如果對數(shù)據(jù)隱私和持續(xù)算力需求較高,建議選擇本地搭建GPU集群。

在AI訓(xùn)練(Training)和AI推理(Inference)場景下,不同GPU的性能表現(xiàn)存在明顯差異。主要區(qū)別體現(xiàn)在計算精度、帶寬需求、顯存優(yōu)化以及核心架構(gòu)等方面。以下是詳細(xì)對比:

在AI計算中,不同的數(shù)值格式影響計算速度和精度:

|

|

|

|

|

|

|---|---|---|---|---|

| FP32 |

|

|

|

|

| TF32 |

|

|

|

|

| FP16 |

|

|

|

|

| INT8 |

|

|

|

|

H100 特別優(yōu)化了 Transformer Engine,在 FP8/FP16 下可大幅提升 AI 訓(xùn)練和推理性能,適用于 LLM(大語言模型)如 GPT-4。

訓(xùn)練任務(wù) 通常需要處理大規(guī)模數(shù)據(jù),因此高顯存帶寬至關(guān)重要:

推理任務(wù) 一般不需要大帶寬,因為:

在計算核心優(yōu)化上:

|

|

|

|

|---|---|---|

| A100 |

|

|

| H100 |

Transformer Engine

|

|

| A800 |

|

|

| H800 |

|

|

| H20 |

|

|

H100 在 Transformer-based AI 任務(wù)(如 GPT)中比 A100 快 6 倍,而推理吞吐量也更高。

未來,隨著 H20 逐步普及,它可能成為中國市場AI訓(xùn)練和推理的[敏感詞]。

根據(jù)GPU型號,搭建算力中心的成本會有所不同:

一個基礎(chǔ)的4張H100服務(wù)器可能需要20萬-50萬美元,而大型AI訓(xùn)練集群(如64張H100)則可能超過千萬美元。

免責(zé)聲明:本文采摘自“ittbank”,本文僅代表作者個人觀點,不代表薩科微及行業(yè)觀點,只為轉(zhuǎn)載與分享,支持保護(hù)知識產(chǎn)權(quán),轉(zhuǎn)載請注明原出處及作者,如有侵權(quán)請聯(lián)系我們刪除。

友情鏈接:站點地圖 薩科微官方微博 立創(chuàng)商城-薩科微專賣 金航標(biāo)官網(wǎng) 金航標(biāo)英文站

Copyright ?2015-2025 深圳薩科微半導(dǎo)體有限公司 版權(quán)所有 粵ICP備20017602號